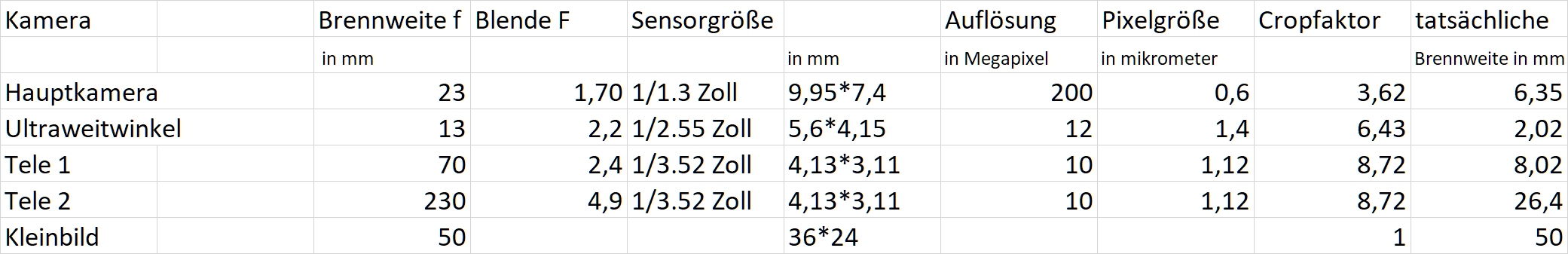

Bei den Kameras der Handys spielt das Zoomen eine wesentliche Rolle.

Auf Grund der begrenzten Platzverhältnisse in Handys ist es schwierig, optischen Zoom unterzubringen.

Deshalb versuchen die Handyhersteller viel, um das Zoomen zu verbessern,

sowohl optisch, indem bspw. Periskoptechnik

verwendet wird, als auch digital.

Zunächst aber was ist optisches Zoom. Hierzu mein Verständnis dazu.

Unter optischem Zoom verstehe ich die Vergrößerung durch die Optik, also die Zusammenhänge Brennweite, Sensorgröße und Auflösung, schlechthin als Zoom bezeichnet, aber auch die Vergrößerung durch die Anzeige.

Zusammengefaßt:

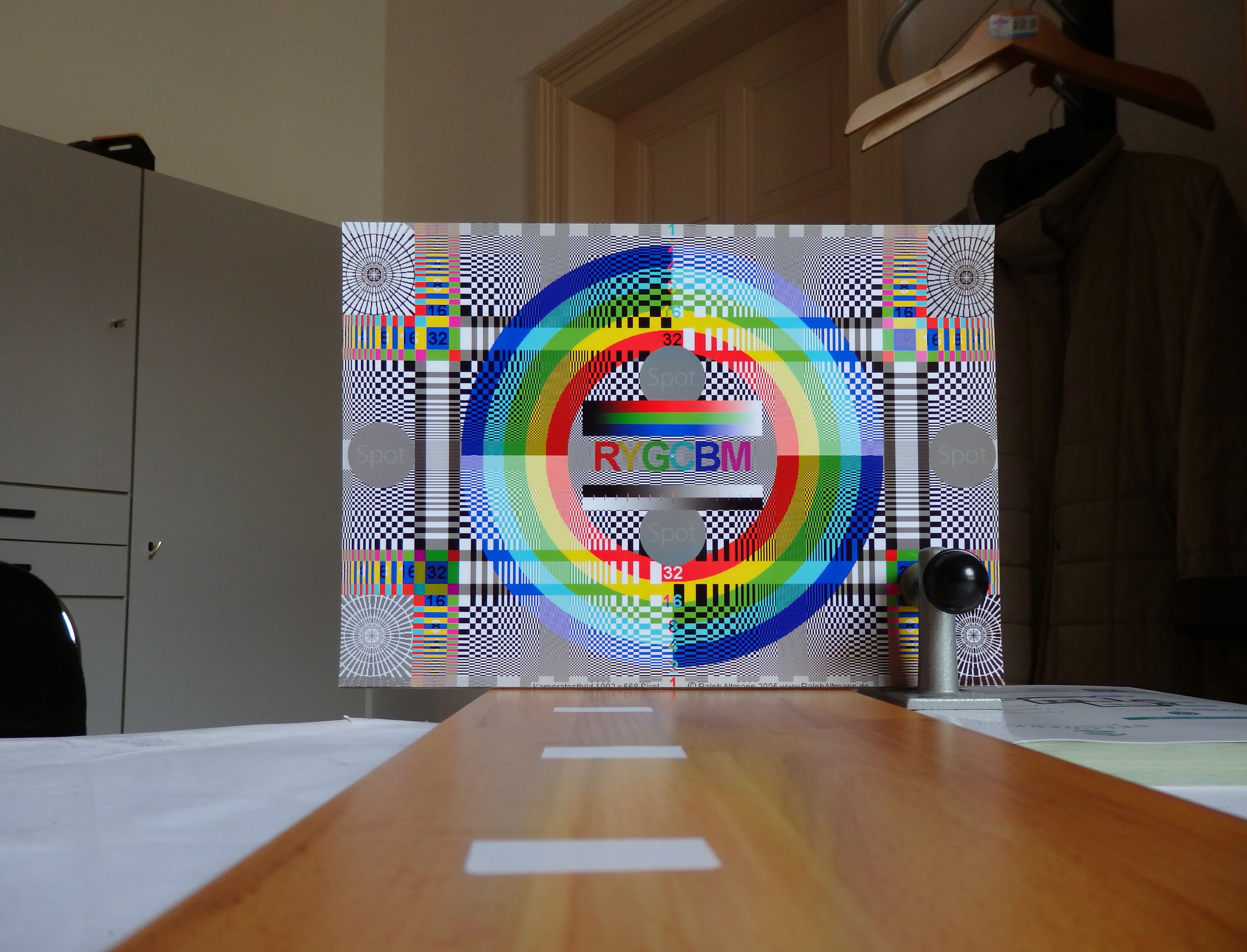

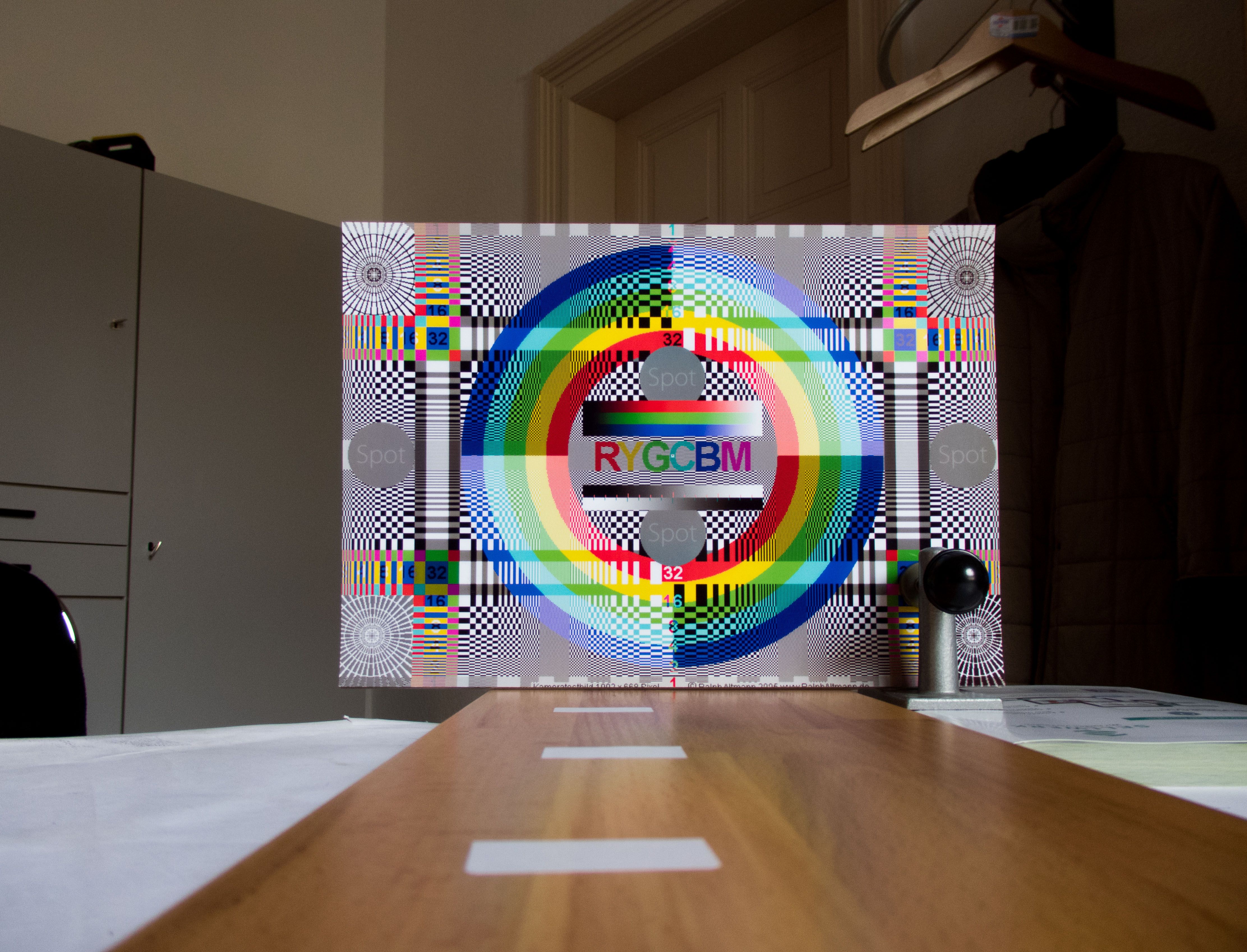

Das optische Zoom endet damit, daß jedes Pixel des Sensors durch die Optik 1 zu 1 angesteuert wird (100%-Anzeige).

Eine meiner Kompaktkameras, die Canon SX 740, hat eine Auflösung

von 5184 mal 3456 Pixel und ein optisches Zoom von 40,

kleinbildäquivalente Brennweite 720 mm.

Das entspricht etwa einer Auflösung von 18 Megapixel.

Nun sind 18 Megapixel als Auflösung sehr viel, vgl. meinen Beitrag zu Smartphone Samsung Galaxy S23 ultra.

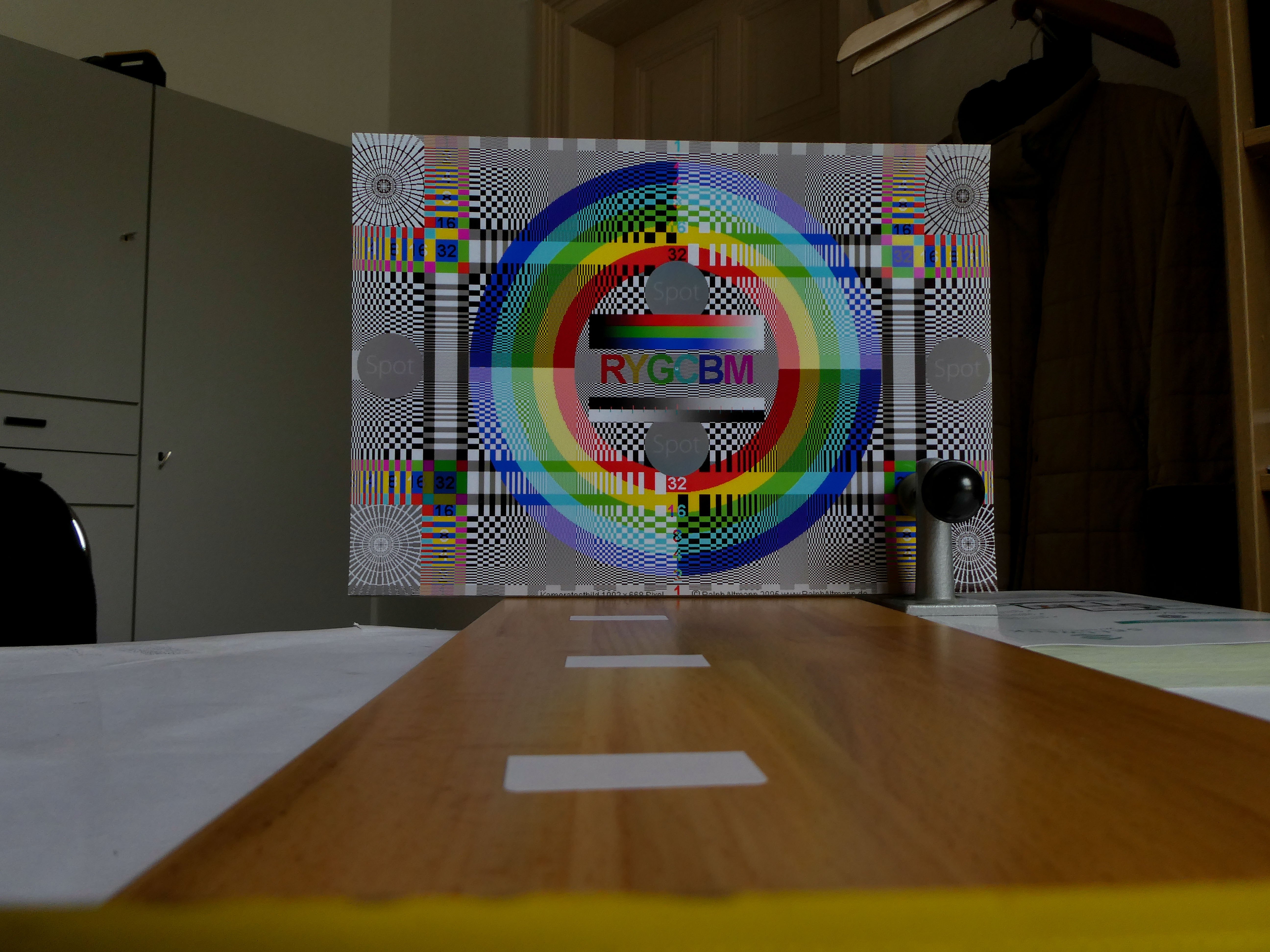

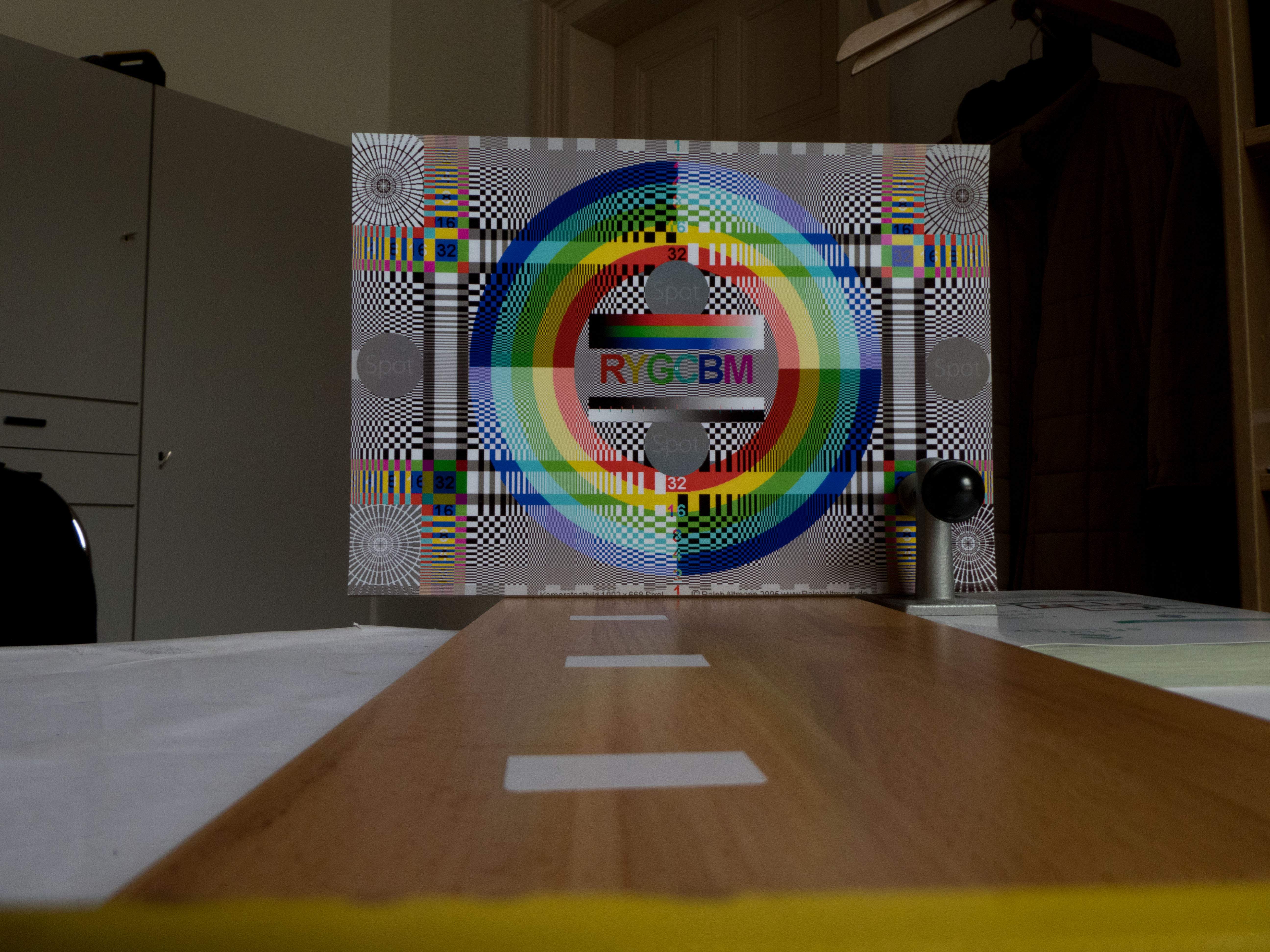

Wenn ich ein Bild dazu aufnehme und dieses Bild auf meinem 4k-Bildschirm 1:1 darstelle, wird nur ein Teil des Bildes dargestellt. Der Teil errechnet sich durch das Verhältnis Auflösung des Bildschirmes durch Auflösung des Bildes unter Berücksichtigung der unterschiedlichen Formate 16:9 bzw. 3:2, also

(3840*2160)/(5184*3456)*(16/9)/(3/2)=0,55

Dieser Bildausschnitt stellt eine zusätzliche Vergrößerung dar, die ich noch unter optischer Vergrößerung, sprich optisches Zoom, sehe.

Mein Beitrag zur 100%-Ansicht kann hier hilfreich sein.

Vergrößerungen gehen mit dem Quadrat der Auflösung einher,

d. h. wenn ich die oben genannten 18 Megapixel 1:1 auf einem

full HD Bildschirm 1920 mal 1080, also etwa 2 Megapixel, darstelle,

ergibt sich ein Bildausschnitt mit einer opptischen Vergrößerung

von etwa 3, d. h. die Kamera Canon SX740 hat bei 1:1-Darstellung auf

einem full HD Bildschirm eine optische Vergrößerung von etwa 120.

Deshalb versucht man bei den Handykameras das optische Zoom dadurch zu vergrößern, in dem man die Auflösung der Sensoren erhöht.

Mein Handy, ein Oppo Reno 2 Z, hat eine Hauptkamera, Weitwinkel, feste Brennweite, mit 48 Megapixel Auflösung. Wenn ich Bilder in diesem Modus aufnehme und auf meinem 4k-Bildschirm 1:1 darstelle, habe ich eine optische Vergrößerung von etwa 2,4 fach, obwohl das Handy keine Telekamera hat.

Das Samsung Galaxy S23 ultra hat eine Telekamera mit 10 fach optischem Zoom, Brennweite kleinbildäquivalent 230 mm, der Sensor hat eine Auflösung von 10 Megapixel, also nur etwas höher als der 4k Bildschirm mit seinen etwa 8 Megapixel, d. h. bei diesem Handy ist mit 10 fach optischem Zoom und Betrachtung 1:1 auf einem 4k Bildschirm mit reichlich 10 facher Verstärkung etwa Schluß. Bei Betrachtung auf einem full HD Bildschirm erhöht sich die optische Verstärkung auf reichlich 20 fach.

10 fach optisches Zoom ist momentan bei Handys das höchste

mir bekannte Zoom.

Aber unter Berücksichtigung des vorher Beschriebenen kommen die neuesten Handys trotzdem zu höheren optischen Vergrößerungen.

Das Samsung Galaxy S25 ultra hat zwar bei der 2. Zoomkamera nur noch eine kleinbildäquivalente Brennweite von 115 mm, also 5 fach Zoom, aber der Sensor hat eine Auflösung von 50 Megapixel. Vorausgesetzt die Pixel werden 1:1 verwendet, d. h. es wird kein Pixelbinning angewendet, ergibt sich auf Grund der hohen Auflösung des Sensors eine zusätzliche optische Vergrößerung von reichlich 2 fach, d. h. bezogen auf die Darstellung auf einem 4k Bildschirm beträgt der optische Zoom insgesamt reichlich 10.

Wenn man das Ganze auf einem Full HD Bildschirm mit 1920 mal 1080 Pixel, also etwa 2 Megapixel, 1:1 betrachtet, erhöht sich die optische Vergrößerung nochmals um etwa 2, so daß man bei dem Samsung Galaxy S25 ultra für die 2. Telekamera von einer optischen Vergrößerung von etwa 20 sprechen kann.

Nun gibt es mittlerweile Telekameras von Handys die mit 200 Megapixel arbeiten. Dadurch wird die optische Vergrößerung/Zoom gegenüber einem Sensor mit 50 Megapixel nochmals um den Faktor 2 erhöht.

Theoretisch ist es also möglich, durch weitere Steigerung der Pixelzahl der Sensoren noch höhere optischen Vergrößerungen/Zoom zu erzielen, bspw. mit einem Sensor mit 800 Megapixel gegenüber 200 Megapixel nochmals um den Faktor 2. Praktisch stößt das momentan natürlich an andere Grenzen

Diese Zusammenhänge sollte man verstehen, um den teils unterschiedlichen Aussagen zu den Kameras der Handys folgen zu können.